作者 | 王世昕

在當今的數字化浪潮中,大模型以其卓越的語言理解和生成能力,正成為推動業務創新的重要引擎。隨著「模型即服務」在雲服務領域的崛起,企業對於高效、經濟的 AI 模型應用的需求日益迫切。然而,現實中大模型的應用並非一帆風順,企業在嘗試將其融入業務流程時,往往面臨著效果不盡人意、成本高昂以及落地難度大等諸多挑戰。

在這樣的背景下,大模型的實踐應用不應僅僅是市場的「噱頭」,企業客戶迫切需要真正「好用、能用、有用」的產品和服務。更重要的是「性價比」,產品能力固然重要,但在市場競爭如此激烈的今天,價格已經成為了企業客戶決策的第一要素。

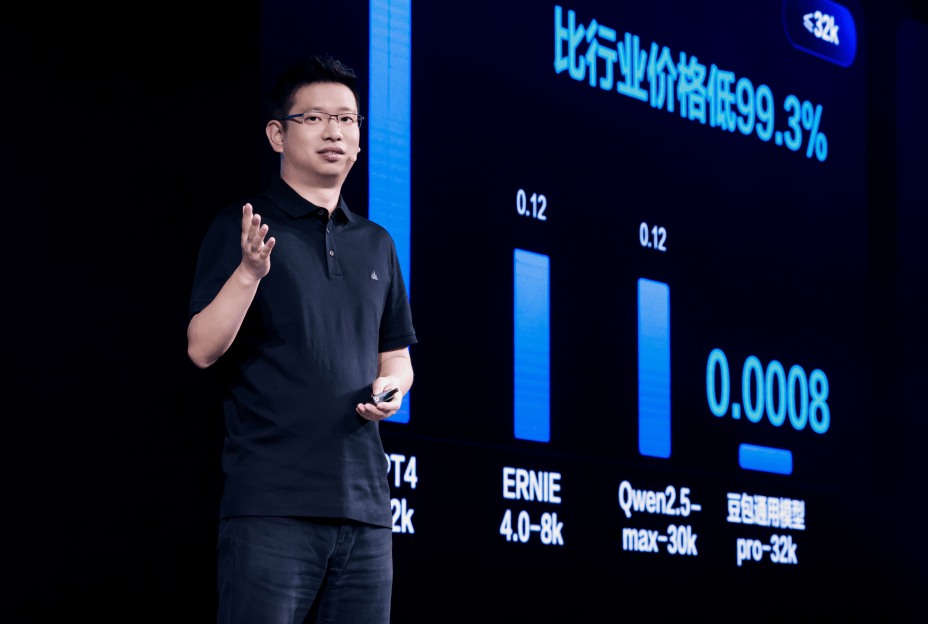

5 月 15 日,2024 火山引擎 FORCE 原動力大會上,火山引擎重磅發布了豆包大模型家族和火山方舟 2.0 等一系列創新產品,並且宣布豆包主力模型在企業市場的定價為 0.0008 元 / 千 tokens,0.8 厘就能處理 1,500 多個漢字,比行業便宜 99.3%,是當之無愧的「超低價」。

「大模型的超低定價,來源於我們在技術上有信心優化成本。」 火山引擎總裁譚待在大會上表示,技術上的優勢,為火山引擎提供了定價的底氣。火山引擎不僅想為企業提供模型服務,更致力於打造一個完備而有效的全棧 AI 技術服務生態,為企業提供模型服務的全鏈路解決方案。

那麼,相對於市面上的其他產品,位元組跳動的模型產品和火山引擎的模型服務到底有何優勢?火山引擎又將如何打造全棧模型服務能力,為企業的智能化升級提供支持?

1模型應用進化,實踐是最好的磨刀石

相比市面上大多數 AI 產品的「大張旗鼓」,位元組跳動的 AI 產品一直保持著低調作風,但不知不覺中,以豆包 App、扣子為代表的位元組系 AI 應用已然成為了用戶的熱門選擇。

以豆包 App 為例,自 2023 年 8 月上線以來,就攻陷了各大應用市場的下載榜單,據悉,截止目前,豆包 App 下載量已經超過 1 億,桌面端 +App 的月活用戶數量已經達到了 2600 萬,有超過 800 萬個智能體被創建,是當之無愧的明星 AI 產品;扣子也早已在海內外打出名氣,憑藉超強的擴展性和性價比攻城略地。能在火熱的 AI 應用市場中脫穎而出,並在大眾對於 AI 認知趨於理性後,仍舊保持著高訪問量、調用量和活躍度,豆包 App 和扣子的「實力」有目共睹。

這直接戳中了當下 AI 應用普遍面臨著的痛點:不怕不好用,只怕沒人用。基於大模型產品的技術特性,只有最大的使用量,才能打磨出最好的模型,只有最多的實踐數據,才能催動「智能湧現」的發生,而在龐大使用量和實際場景的鍛鍊下,應用才能更好地滿足用戶的使用需求,實現持續疊代。

遺憾的是,對於很多產品來說,沒有 GPT 那樣的頂流地位,想實現「應用進化」非常艱難。

而作為行業中的「標杆案例」,豆包大模型就是在「千錘百鍊」下長成的。現如今,豆包大模型平均每天處理 1200 億 tokens(約 1800 億漢字),生成 3000 萬張圖片,對於火山引擎和豆包大模型來說,模型服務早已不是「紙上談兵」,其正在用戶、企業的實際應用中不斷疊代與進化。

首先是位元組跳動內部 50+ 業務的持續打磨。基於位元組跳動龐大的業務生態,豆包大模型光是在內部就能接觸到足夠豐富的業務場景。據悉,豆包大模型不僅參與到辦公智能助手、數據智能分析、編程助手等企業內部的辦公開發場景,還覆蓋了電商導購、售後客服、營銷創作等前端對客場景,在位元組跳動 50 余個實際業務的打磨之下,豆包大模型被應用在一線使用場景中,在位元組系產品的龐大用戶量、數據量的催化下,豆包大模型得以快速疊代。

除了內部打磨、C 端實踐,企業端場景的應用至關重要,這決定著模型是否能真正成為「生產力工具」。現如今,豆包大模型已經被廣泛應用於火山引擎的企業服務中,覆蓋了智能終端、汽車、金融、消費等多個重要行業,更多觸達了 OPPO、vivo、小米、榮耀、三星、華碩、招行、捷途、吉利、北汽、智己、廣汽、東風本田、海底撈、飛鶴...... 等知名企業。

大會上,火山引擎與企業客戶宣布共同成立兩大模型聯盟:智能終端大模型聯盟與汽車大模型生態聯盟,在智能終端 AI、汽車全場景 AI 等領域進一步展開探索,這也讓豆包大模型的未來發展充滿了更多可能性。

2豆包大模型家族發布:多元場景、安全可控

實踐應用是模型能力進化的關鍵環節,但如何為模型服務開拓更多用戶、尋找更多落地機會,則需要更深入的思考。不得不承認,當前企業客戶對於模型服務存在一種「為了用而用」的誤區,這往往導致模型服務與實際需求之間出現偏差。當需求得不到滿足時,對前沿技術的過度依賴也可能變成一種資源浪費,這不利於整個行業的可持續發展。

對於火山引擎等行業內的領軍企業來說,誰能真正洞察企業客戶的深層需求,誰就能占據有利地位。從當前雲計算與智能化融合的趨勢來看,AI 及大模型若想助力企業業務創新升級,主要需要實現三大目標:

能滿足上述三大目標的模型服務產品,不僅要有模型本身的卓越性能,還需要滿足可用性、易用性、成本可控、安全合規等需求。這就要求模型服務產品本身不能有明顯的缺陷。

或許正是基於這樣的洞察,位元組跳動選擇推出豆包大模型家族,加持火山引擎的模型服務能力。

首先,模型的性能效果仍然是核心。正如上文所述,豆包大模型在模型效果上實現了顯著提升。以位元組跳動自研的 LLM 模型專業版「豆包通用模型 pro」為例,其最大窗口尺寸可達 128K,且全系列可精調,具備強大的理解、生成、邏輯和記憶能力,適用於問答、摘要、創作、文本分類、角色扮演等通用場景,功能全面。

針對不同的業務場景和多模態需求,豆包大模型也實現了進一步的進化。除了通用模型,還包括 5 秒即可實現聲音 1:1 克隆的聲音復刻模型、具有超自然語音合成能力的語音合成模型、準確率極高的語音識別模型、扣子背後的主力模型 Function Call,以及角色扮演模型、文生圖模型、向量化模型等。它們共同構成了豆包大模型家族,旨在滿足各行業、多元場景的服務需求。

針對企業的個性化需求,豆包的主力模型提供了通用全面的 pro 版本和低延遲、高性價比的 lite 版本,企業可以根據自身需求靈活選擇。同時,全系列語言模型均支持繼續預訓練或 SFT 精調,使企業能夠基於自身業務場景,自主開發更適配的 AI 應用。豆包將模型精調和預訓練的能力賦予客戶,使企業能夠實現「一個模型,多元應用」。

更重要的是,這一次豆包大模型真正做到了「人人用得起」,豆包主力模型在企業市場的定價只有 0.0008 元 / 千 tokens,0.8 厘就能處理 1,500 多個漢字,比行業便宜 99.3%。在這樣的「卷」的價格之下,企業可以真正做到降本增效,用低成本創造新價值。

大會上,火山引擎總裁譚待表示,有信心通過技術優化降低成本。例如通過對模型結構的優化調整、在工程上從以前的單機推理演進到現在的分布式推理、把不同負載的推理混合調度,這些技術能夠把各種各樣底層算力用得更好,同時實現大幅的降低成本,讓每一家企業都能用得起大模型。

在金融、科技等行業客戶極為關注的安全問題上,豆包大模型作為首批通過大模型服務安全備案的產品,滿足了合規性需求。在火山方舟平台全周期安全可控方案的支持下,豆包大模型在數據加密傳輸、信息內容安全、防止惡意攻擊和數據泄露等方面提供了有力保障,讓企業能夠放心使用。

3從應用到平台,火山引擎全棧模型服務是如何煉成的?

豆包大模型家族已經為火山引擎的企業客戶提供了強大的模型服務解決方案,但這只是一個開始。火山引擎的終極目標是通過其大模型雲計算能力,全面賦能企業,助力其在 AI 時代實現數字化與智能化的升級。這一願景在火山方舟 2.0 的推出中得到了充分體現。

作為一站式大模型服務平台,火山方舟 2.0 在性能和系統承載力方面實現了顯著提升。平台擁有海量資源,能夠通過資源潮汐調度保障流量高峰時業務的穩定性。同時,其瞬時可用的特性,使得創建模型接入點後 5 秒即可使用,大大提升了業務的響應速度。極致彈性的擴縮容能力,為企業有效支撐突發流量和業務高峰提供了保障,同時降低了成本。

在企業 AI 應用的穩定性和成本控制方面,火山方舟 2.0 為企業級 AI 應用的落地提供了堅實的基礎。而三大核心插件則進一步加速了企業 AI 應用的產出與創新。

聯網插件提供了與頭條、抖音相同的搜索能力,結合多模態交互方式和領先的意圖識別技術,大幅提升了模型的信息獲取能力。內容插件則依託位元組跳動體系的海量內容資源,通過基於意圖的垂直內容信息檢索,提供了內容時效性更強的解決方案。RAG 知識庫插件以其毫秒級的高性能檢索和流式知識庫索引更新,降低了企業在使用 AI 模型時的「幻覺」,提升了應用的實用性。

扣子專業版的推出,使得企業或創業者可以接入更多高級特性,享有企業級的各項能力。在扣子原有功能基礎之上,扣子專業版提供企業級性能的智能體運行時。保障各項服務 SLA,包括但不限於並發量、響應時長等。並開放 SSO、組織權限管理等企業特性。

可以預見,未來將有越來越多的企業利用扣子專業版進行多場景的開發,非編程人員也可以更好地使用上 AI,為工作全流程進行提效。除此之外,火山引擎還推出了智能創作雲 2.0,發布了智能數據洞察 AI 助手 ChatBI、銷售 AI 助手 Sales Copilot 等 AI 應用,幫助企業快速實現 AI 升級。

全棧 AI 技術服務生態的構建不僅僅在於模型服務本身和 AI 應用開發,基礎設施的匹配升級同樣重要。在這次升級中,火山引擎還對旗下雲底座進行了全面升級。會上,火山引擎全新發布了混合雲 veStack 智算版,其擁有著萬卡集群組網,3.2T 高性能無損網絡的超大規模優勢、可以實現 97.78% 訓練加速比和分鐘級故障發現和自愈的極致性能,還能夠適配十餘種 GPU 和主流國產化 GPU,應對本地部署需求。

通過這些升級,火山引擎展現了其全棧 AI 技術服務生態的構建能力。從基礎設施到模型即服務(MaaS)、模型應用,火山引擎的技術服務生態為企業提供了全方位的支持,幫助企業在 AI 時代實現數字化與智能化的升級,推動業務的持續增長和創新。

火山引擎的這一系列動作,無疑是對 AI 技術應用的一次深刻洞察和前瞻性布局。火山方舟 2.0 的推出,不僅為企業提供了更加強大和靈活的 AI 應用開發平台,更是在推動整個行業向更高效、更智能的方向發展。隨著火山引擎全棧 AI 技術服務生態的不斷完善,我們有理由相信,它將為企業帶來更多的可能性,開啟 AI 技術應用的新篇章。