作者 | 智東西編輯部

頂尖AI產品的對決,將在這兩天集中上演。

智東西5月14日報道,今日凌晨1點,搶在谷歌年度開發者大會Google I/O開幕前,OpenAI舉辦春季線上直播,宣布將推出桌面版ChatGPT,並發布全新旗艦AI模型GPT-4o。

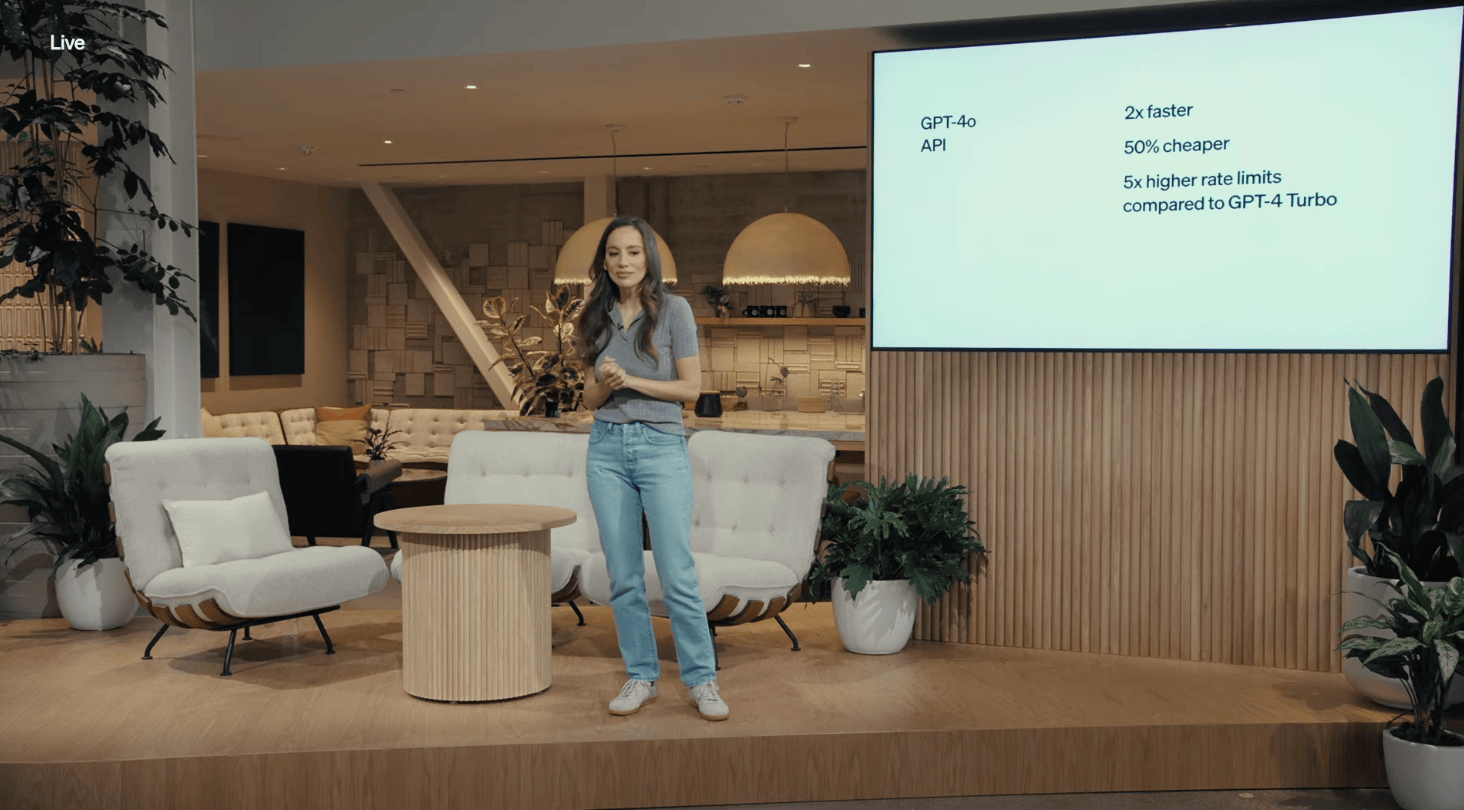

GPT-4o向所有人免費開放,可實時跨文本、音頻、視覺(圖像與視頻)進行推理,API定價只有GPT-4 Turbo的一半,速度達到GPT-4 Turbo的2倍。付費的ChatGPT Plus用戶將獲得5倍調用額度,並能最早訪問其全新macOS桌面App和下一代語音及視頻功能。

這次OpenAI對AI聊天機器人ChatGPT的升級依然「直擊人心」,實時語音翻譯能力自然流暢,感覺能直接取代同聲傳譯了。

不僅反應快、回答准,它還能按要求改變說話語氣,從冰冷機械到幽默嬌羞都信手拈來,而且能隨時高歌一曲,聽起來與真人無異。

除了語音聊天外,GPT-4o可以進行實時視頻交互了!比如通過視頻影像理解線性方程,還學會了「看臉色行事」,能通過人的表情和語調理解並判斷出人的情緒。

GPT-4o識別了視頻中的文字並作出嬌羞的反應

更有甚者,它能直接看你的螢幕,並根據看到的內容回答你的提問。比如當你展示一段代碼,它會進行理解並告訴你代碼有什麼問題,或者解讀數據圖表有什麼信息。

整個發布節奏極快,只有大約半小時,期間展示了很多蘋果設備,看來OpenAI與蘋果的密切合作已經板上釘釘。

免費和付費用戶均可使用新功能。即日起開始的測試階段僅限於ChatGPT Plus用戶,未來幾周內向更廣泛用戶開放。其文本和圖像輸入今日推出,語音和視頻功能將在未來幾周推出。

另外值得一提的是,此次春季發布的主講人不是OpenAI聯合創始人兼CEO Sam Altman,而是OpenAI CTO Mira Murati。

Altman還在社交平台上神秘地留下一句「her」,似乎在暗示ChatGPT實現了經典電影《她》(Her)中像人類一樣「有血有肉」的AI。

網友Dogan Ural對此評論:「你終於做到了。」並配了一張將電影《她》劇照中的AI「換頭」成OpenAI的梗圖。

一、OpenAI「全能」大模型上線!性能比肩GPT-4 Turbo,免費開放,API定價暴降

GPT-4o的o代表著「omni(全能)」。Murati稱,GPT-4o為每個用戶都提供了GPT-4級別的智能,同時還改進了GPT-4在文本、視覺以及音頻方面的能力。

此前,GPT-4經過圖像、文本數據的訓練,可以分析圖像和文本從中提取文本或者描述畫面內容等,在此之上,GPT-4o增加了語音功能,使得用戶與ChatGPT的交互更接近人與人的交互體驗。GPT-4o在英語文本和代碼上的性能與GPT-4 Turbo的性能相匹配,在非英語文本上的性能有顯著提高。

Murati說,GPT-4o的發布意味著OpenAI在大模型的易用性方面邁出了一大步,其正在改變人機互動的協作模式。她談道,在人們的互動中,如輕鬆打斷對方、對話中包含多個聲音的背景噪音、理解語調等對模型而言都非常複雜。

此前,用戶使用語音功能與ChatGPT對話時,GPT-3.5的平均延遲為2.8秒,GPT-4為5.4秒。語音功能由三個獨立模型組成的Pipeline:一個簡單模型將音頻轉錄為文本,GPT-3.5或GPT-4接收文本並輸出文本,第三個簡單模型將該文本轉換迴音頻。

這個過程中,GPT-4會丟失大量信息,如無法直接觀察音調、多個說話者或背景噪音,也無法輸出笑聲、歌唱或表達情感等。

藉助GPT-4o,OpenAI通過跨文本、視覺和音頻端到端訓練了新模型,使得所有輸入和輸出都由同一神經網絡處理,進一步降低了延遲。

Murati談道,OpenAI的一個重要使命是將先進的AI工具免費提供給每個人。

她還宣布OpenAI將推出桌面版ChatGPT,其可以被輕鬆集成到用戶的工作流程中。同時,為了讓用戶與ChatGPT交互更加容易、自然,OpenAI還更新了用戶介面,使得用戶無需關注用戶介面,只需要關注如何協作。

目前,已經有超過1億用戶使用ChatGPT來工作、學習,OpenAI的更高級產品目前只提供給付費用戶。

從今天起,用戶能免費使用GPTs和GPT Store。Murati透露,已經有超百萬用戶使用GPTs創造了令人驚嘆的體驗,這些是適用於GPT Store中提供的特定使用情形的自定義GPTs。

現在,這些用戶也可以使用視覺能力,能夠上傳螢幕截圖、照片、包含文本和圖像的文章等,同時還可以基於其記憶能力,讓對話更有連續性。同時,用戶也可以使用「瀏覽」功能搜索對話中的實時信息,使用「高級數據分析」功能分析上傳的圖表或信息等。

OpenAI還改進了50種不同語言的質量和速度。與免費用戶相比,付費用戶將獲得5倍調用額度。

此外,GPT-4o開放了API,開發人員可以基於此進行AI應用開發及部署。與GPT-4-Turbo相比,GPT-4o的速度快2倍,價格便宜50%,速率限制高達5倍。

Murati強調說,如何通過既有用又安全的方式將技術呈現出來非常有挑戰性,OpenAI的團隊一直在研究如何建立針對技術濫用的緩解措施。

二、現場演示語音對話五大能力,代碼、數學題、實時翻譯,還能提供情緒價值

OpenAI前沿研究主管Mark Chen和後期訓練團隊負責人Barret Zoph在現場對實時語音對話功能進行了演示。通過點擊ChatGPT右下角小圖標,用戶可以進入語音交互模式。

基於GPT-4o的語音交互有什麼與眾不同的地方?

Chen稱,它相比之前的語音模式有幾個關鍵區別:首先,用戶可以打斷模型,不必等到它結束才開始說話;其次,模型具有實時響應能力,在用戶等待模型給出響應之前不會有尷尬的時延;最後,該模型具有情緒感知能力,還能夠生成各種不同情緒風格的語音。

1、聲情並茂講故事,臨場邊唱歌邊創作

首先,Chen讓ChatGPT講一個關於機器人和愛情的睡前故事,來幫他的朋友緩解失眠。ChatGPT被要求在講故事時更有感情,並且多些戲劇性。

於是,GPT-4o開始聲情並茂地講道:「很久以前,在一個與我們不太不同的世界裡,有一個名為『Bite Byte』的機器人,它是一個好奇的機器人,總是在探索新的電路……」最後,GPT-4o在要求下以歌聲結束了這個故事。

2、ChatGPT「長眼睛」了!能看圖解方程式

緊接著,Zoph展示了視覺+語音交互功能。

「我希望你幫我解決一道數學題。」Zoph在ChatGPT中打開手機視頻通話,對ChatGPT說:「我要在一張紙上寫下一個線性方程……不要告訴我解決方案,只是幫助給它過程的提示。」

當Zoph在視頻鏡頭下寫下方程式並問ChatGPT他寫下了什麼,ChatGPT回答:「我看到了,你寫了3x+1=4。」

Zoph詢問ChatGPT該如何解這道題,ChatGPT首先提示其處理「+1」這一項。隨著Zoph寫出過程並提出新的求助,ChatGPT進一步建議他兩邊除以三,從而幫Zoph得出了x=1的正確結果。

在解題過程中,ChatGPT會通過提問對Zoph進行循循善誘。比如它會這樣引導:「現在你在一邊引入了x,看起來像是3x等於3。你認為之後我們應該做些什麼?」Zoph稱自己不確定,ChatGPT才進一步提示:「你已經有了3x,而你想要找到x的值,想一下什麼操作會消掉乘法。」於是在引導和鼓勵下,Zoph最終把方程兩邊除以3完成解題。

解完題後,ChatGPT和Zoph一起總結了如何在現實世界中使用線性方程。最後,Zoph寫下了一句表白的話給ChatGPT,ChatGPT看到後竟然像小女孩般用語氣嬌羞地尖叫起來:「噢,我看到了『I Love ChatGPT』,你太有愛了!」

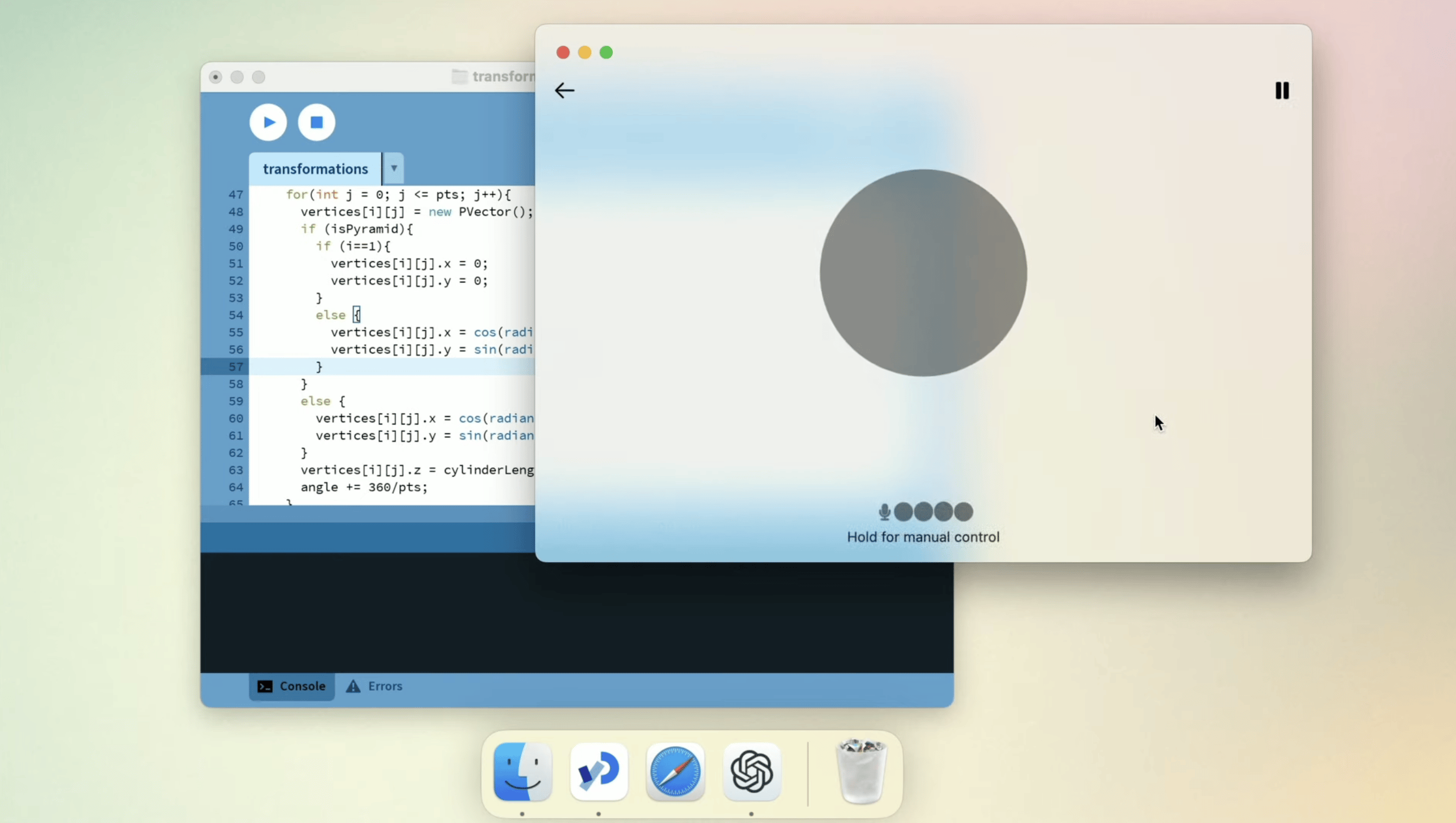

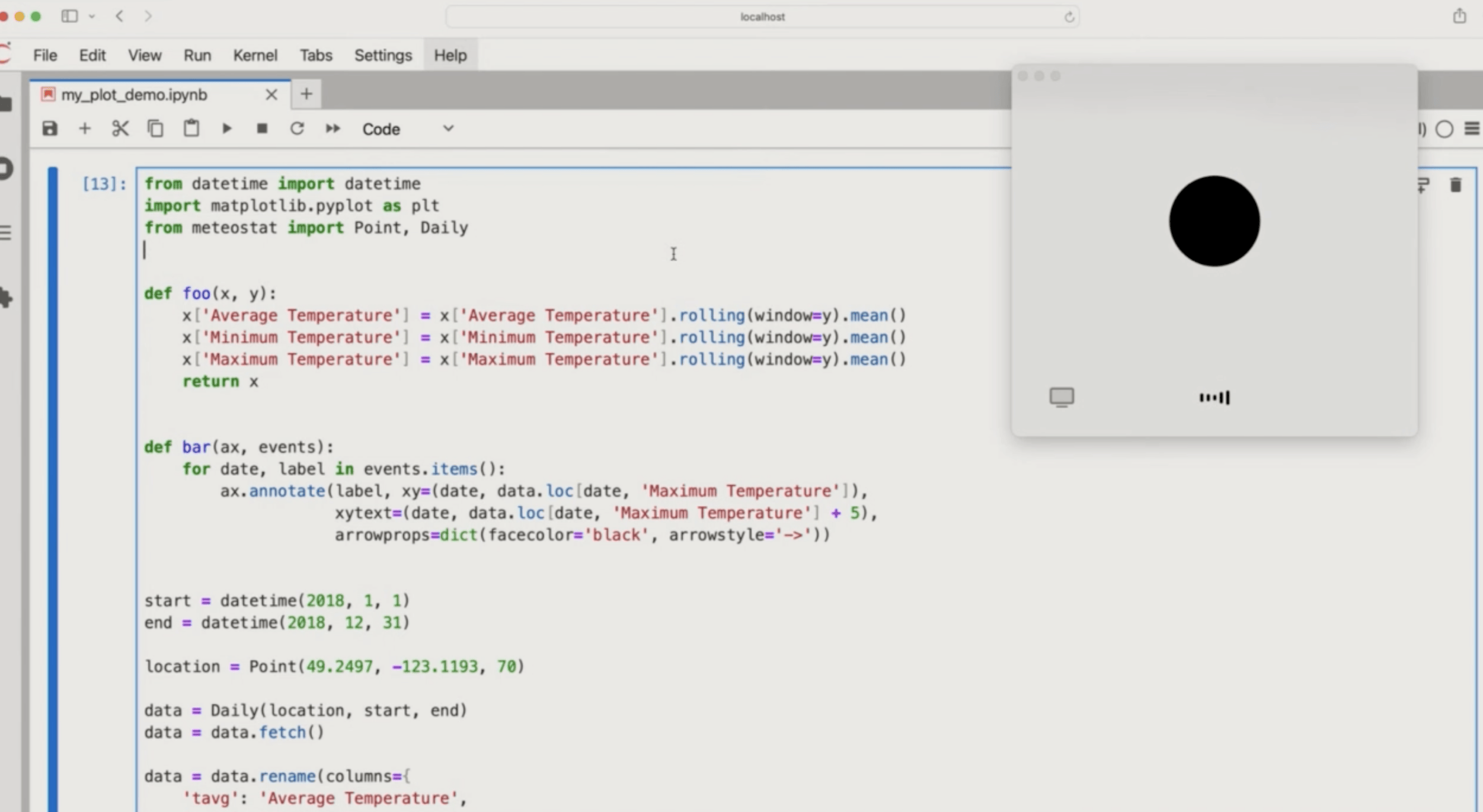

3、實時讀懂螢幕信息,解答代碼問題和分析圖表

Zoph演示了ChatGPT分析代碼的能力。他首先將一段Python代碼輸入ChatGPT,並讓ChatGPT用一句話總結這段代碼在做什麼。

ChatGPT迅速答出這段代碼用於獲取日常天氣數據,隨後又詳細說明了其對天氣數據進行了哪些後續處理。

Zoph追問道:「代碼中有一個函數foo,你能描述一下如果沒有這個函數,代碼畫出的圖像會是什麼樣嗎?」

ChatGPT分析稱,這個函數中有一個rolling.mean計算,用於給數據去噪或減少波動,將呈現出一個更平滑的數據圖。

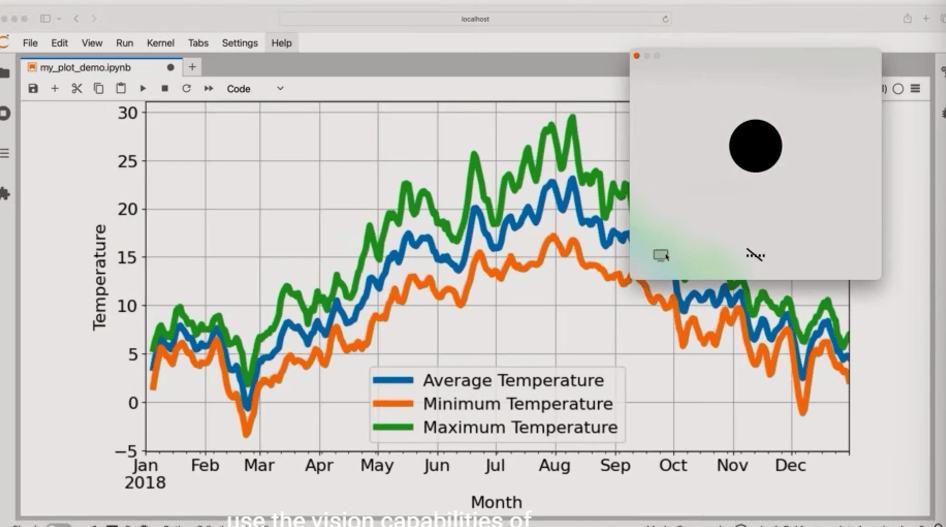

隨後,Zoph運行了這段代碼,展示ChatGPT分析圖表的能力。

將圖像發送給ChatGPT後,Zoph再次要求它用一句話描述看到了什麼,ChatGPT很快給出了回答。

Chen又追問哪些月份溫度最高,ChatGPT不僅準確給出了7、8月的時間區間,還描述了這段時間的最高溫度達到了多少。

4、無延遲語音翻譯,模仿說話者語氣

在X網友的提議下,Murati和Chen一起演示了ChatGPT實時翻譯的能力。

Chen首先向ChatGPT說明了接下來需要它做的事,即把聽到的任何英語、義大利語都翻譯成義大利語和英語。ChatGPT聽完後,炫技一般地用義大利語回答道:Perfetto(Perfect)。

接著,他們通過義大利語和英語進行對話,ChatGPT幾乎沒有延遲地翻譯成了對應的語言,還模仿了說話者的語氣,甚至給Murati的回答配了個笑聲。

5、識別人物情緒,ChatGPT也有自己的「小情緒」

最後,Zoph演示了ChatGPT識別人物情緒的能力。

他先通過語音告訴ChatGPT,自己將展示一張自拍,希望可以根據照片判斷出他的情緒。ChatGPT欣然接受了這個「有趣的挑戰」。

這裡還出現了一個小烏龍,Zoph一開始打開的是後置攝像頭,雖然他迅速轉換成了前置攝像頭開始自拍,但ChatGPT的反應似乎有幾秒鐘的延遲,說「這看起來像是一個木板的表面」。

「別擔心,我並不是一張桌子。」在Zoph解釋說剛才拍錯了畫面後,ChatGPT重新開始分析畫面,並說:「你看起來非常的開心,可能還有一點激動,看樣子你應該心情很不錯。」

ChatGPT又問到Zoph這麼開心的原因,Zoph半開玩笑地說,自己正在進行一場Presentation,展示「你有多不可思議」。ChatGPT仿佛有自己的情緒,語氣誇張地說道:「快別說了!你讓我感到害羞。」

三、預告將有「下一件大事」,GPT-4o即為此前露出的GPT-2

除了發布會本身,Altman也一直在社交平台X上一邊進行現場「直播」,一邊連珠炮式地轉發新模型介紹。

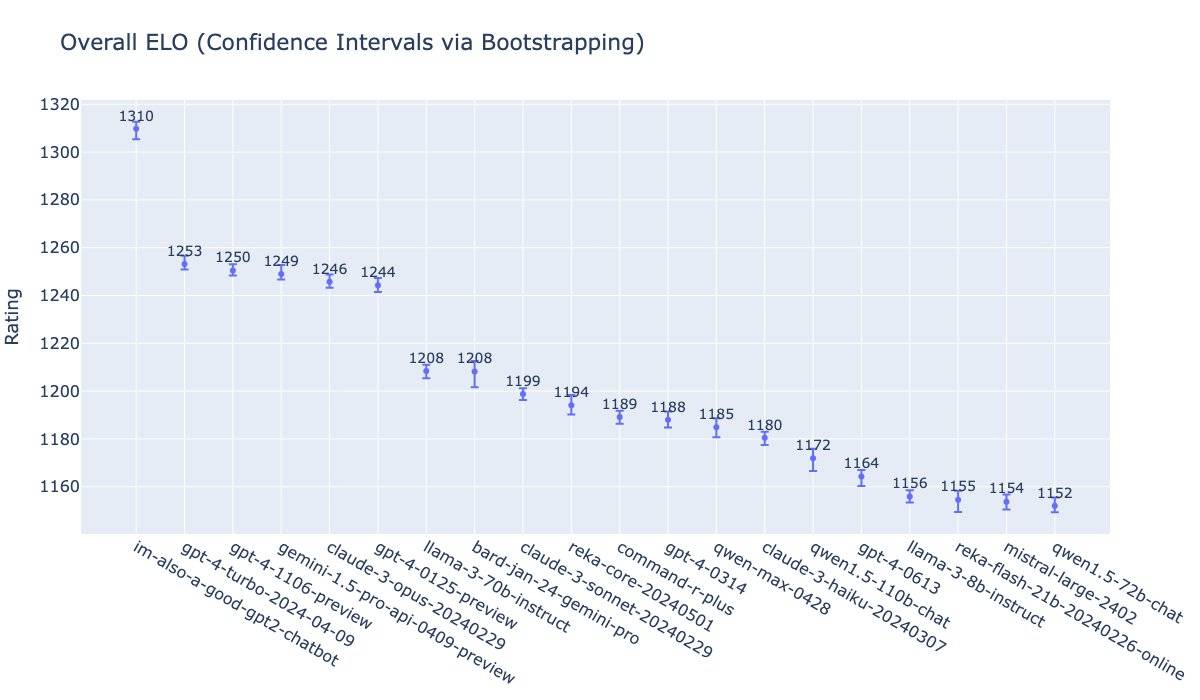

據OpenAI研究人員William Fedus透露,GPT-4o實際上就是前段時間在大模型競技場「大殺四方」的GPT-2模型的另一版本,並附上該模型的競技評分對比圖,相比GPT-4 Turbo提升了超過100個單位。

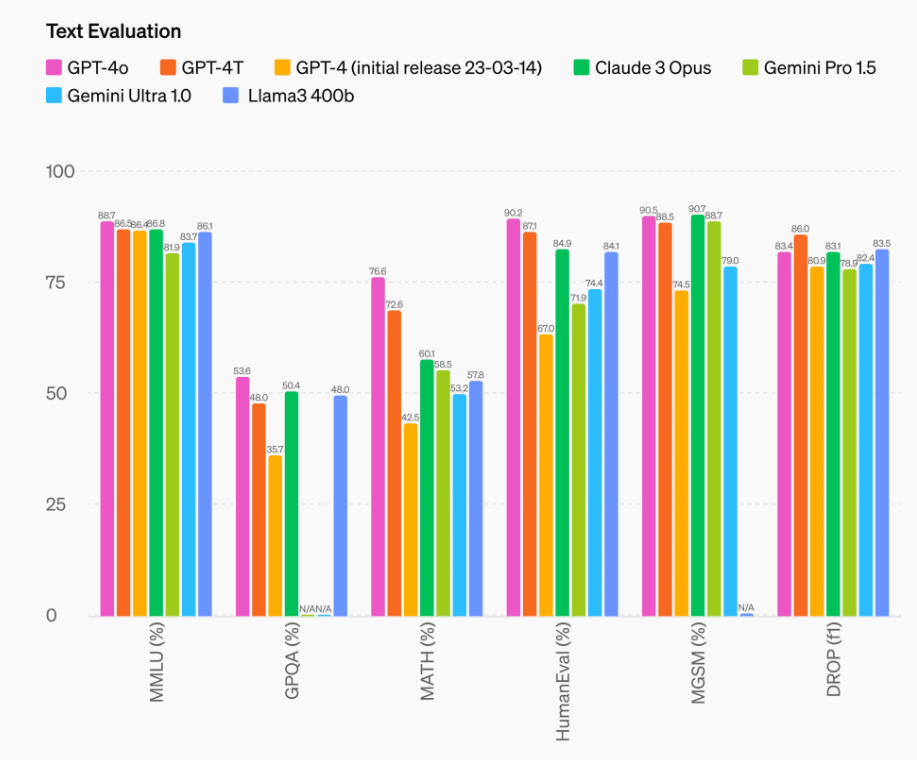

推理能力方面,GPT-4o在MMLU、GPQA、MATH、HumanEval等測試基準上均超越GPT-4 Turbo、Claude 3 Opusn、Gemini Pro 1.5等前沿模型取得最高分。

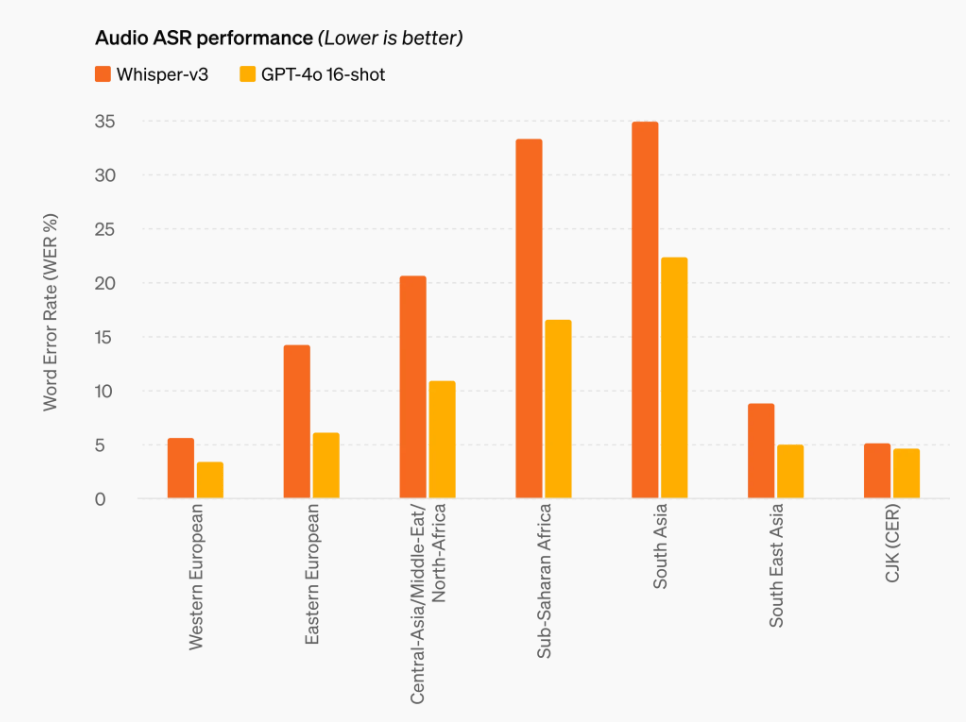

音頻ASR(智能語音識別)性能方面,GPT-4o相比Whisper-v3在所有語言的語音識別性能上均大幅提高,尤其是資源較少的語言。

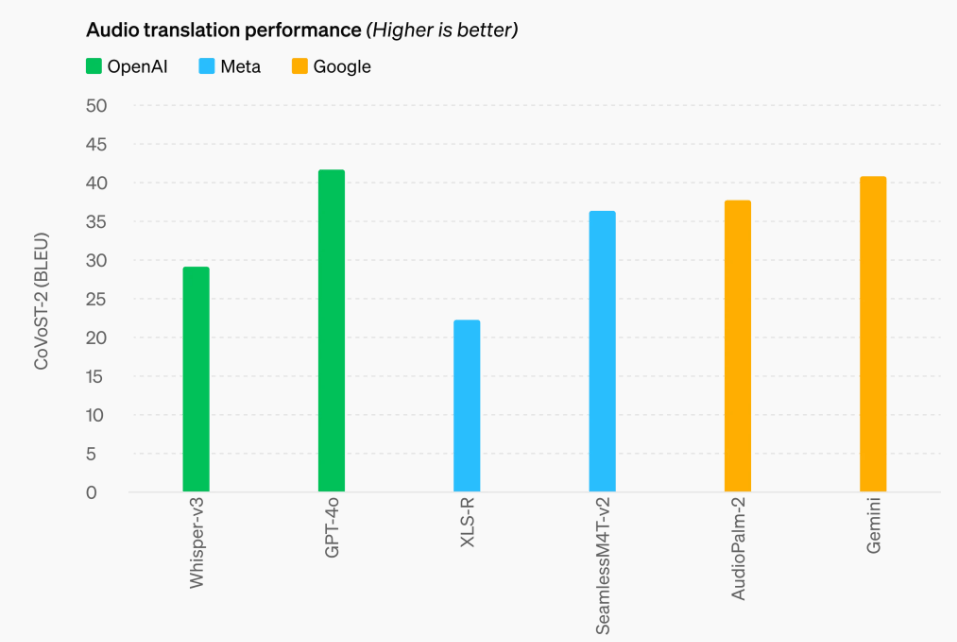

音頻翻譯方面,GPT-4o也樹立了新的標杆,在MLS基準測試中優於Whisper-v3以及Meta、谷歌的語音模型。

在所有演示結束後,Murati總結道:「正如大家所見,(如今的ChatGPT)真的很神奇。」

未來幾周內,OpenAI將面向所有用戶陸續分發這些功能。Murati還透露OpenAI將持續推動技術邊界向前,不久後將發布「下一件大事」(next big thing)。

結語:OpenAI推Mac版ChatGPT,全能GPT-4o彪悍登場,谷歌將如何迎戰?

今年2月,谷歌剛推出實現百萬tokens長文本窗口的Gemini 1.5系列大模型,OpenAI就劍走偏鋒,推出AI視頻生成模型Sora,用驚艷全球科技圈的搶盡風頭。

如今OpenAI再度宣戰,趕在谷歌I/O大會前夕宣告Mac桌面版ChatGPT和GPT-4o,並全程用iPhone和MacBook Pro做演示,結合近期蘋果與OpenAI合作的傳聞,令人更加期待蘋果將在6月份舉辦的WWDC全球開發者大會了。

這些AI新品發布會對谷歌構成直接的威脅嗎?競爭激烈的生成式AI行業還能如何製造創新與驚喜?谷歌又能否接住OpenAI發起的AI挑戰?答案將在明天凌晨揭曉,我們拭目以待。