芯東西(公眾號:aichip001)

作者 | ZeR0

編輯 | 漠影

芯東西6月14日報道,今日凌晨,英偉達的頭號勁敵AMD,終於放出了令人期待已久的AI大招。

2014年,蘇姿豐成為AMD CEO時,這家晶片企業正瀕臨生存危機,裁員約1/4,股價徘徊在2美元。隨後在蘇姿豐的掌舵之下,AMD完成了漂亮的轉身,9年來股價飆升近30倍,對英偉達和英特爾兩家頂級晶片巨頭形成了制衡。

隨著生成式AI颶風席捲全球,英偉達GPU被各家大廠爭相搶購,焦點很快轉移到AMD身上——AMD能否生產出足夠強大的AI晶片來打破英偉達近乎壟斷的市場地位,抓住新一波AI浪潮?

今日,AMD交出階段性答卷。

在展示下一代AI晶片MI300X加速器時,蘇姿豐滿面笑容地說:「我愛這顆晶片」。

MI300X是一個純GPU版本,採用AMD CDNA 3技術,使用多達192 GB的HBM3高帶寬內存來加速大型語言模型和生成式AI計算。

AMD主要客戶將在第三季度開始試用MI300X,第四季度開始全面生產。另一種型號Instinct MI300A現在正在向客戶發售。

蘇姿豐說,人工智慧是AMD「最大、最具戰略意義的長期增長機會」。

現場,AMD與明星AI獨角獸企業Hugging Face宣布了一項新的合作夥伴關係,為AMD的CPU、GPU和其他AI硬體優化他們的模型。

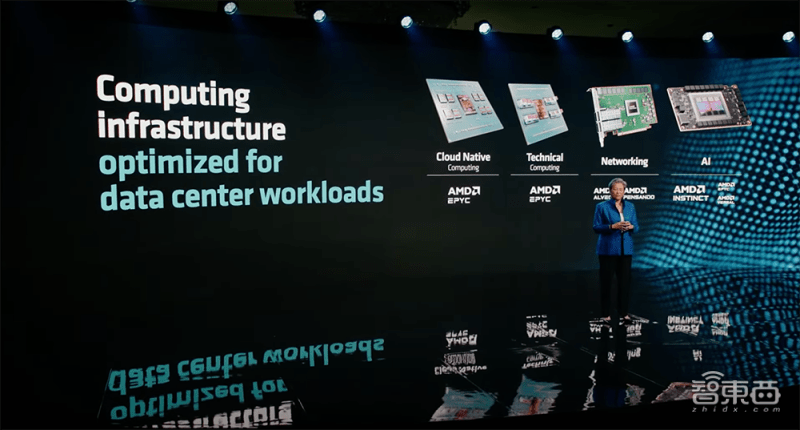

除了AI晶片外,AMD還推出專為雲計算和超大規模用戶設計的全新EPYC伺服器處理器,代號為Bergamo,每個插槽最多包含128個內核,並針對各種容器化工作負載進行了優化。

亞馬遜旗下雲計算部門AWS、甲骨文雲、Meta、微軟Azure的高管均來到現場,分享在其數據中心使用AMD晶片及軟體的感受。

一、加速生成式AI:192GB HBM3,單個GPU跑大模型

此前,AMD Instinct GPU已經被許多世界上最快的超級計算機採用。

MI300X加速器是AMD Instinct MI300系列的新成員,提供一個僅有GPU配置的晶片版本。

MI300X及其CDNA架構專為大型語言模型和其他先進AI模型而設計,將12個5nm chiplets封裝在一起,共有1530億顆電晶體。

這款全新AI晶片捨棄了APU的24個Zen內核和I/O晶片,轉而採用更多的CDNA 3 GPU和更大的192GB HBM3,提供5.2 TB/s的內存帶寬和896GB/s的無限帶寬。

MI300X的HBM密度是英偉達H100的2.4倍,帶寬是英偉達H100的1.6倍,這意味著AMD可以運行比英偉達晶片更大的模型。

AMD演示了在單個MI300X GPU上運行擁有400億個參數的Falcon-40B大型語言模型,讓它寫了一首關於舊金山的詩。

「模型尺寸變得越來越大,你需要多個GPU來運行最新的大型語言模型,」蘇姿豐說,隨著AMD晶片上內存增加,開發者將不需要那麼多GPU。

另一款MI300A被蘇姿豐稱作「面向AI和高性能計算的全球首款APU加速器」,將多個CPU、GPU和高帶寬內存封在一起,在13個chiplets上擁有1460億顆電晶體。

MI300A採用5nm和6nm製程、CDNA 3 GPU架構,搭配24個Zen 4核心、128GB HBM3,相比MI250提供了8倍以上的性能和5倍以上的效率。

AMD還公布了一種AMD Infinity架構。該架構將8個 MI300X加速器連接在一個考慮了AI推理和訓練的標準系統中,提供共1.5TB HBM3內存。

據台媒報道,AMD的Instinct MI300系列以及英偉達的H100/H800系列GPU都在採用台積電先進的後端3D封裝方法CoWoS,導致台積電CoWoS產能短缺將持續存在。台積電目前有能力每月處理大約8000片CoWoS晶圓,其中英偉達和AMD合計占了大約70%到80%。

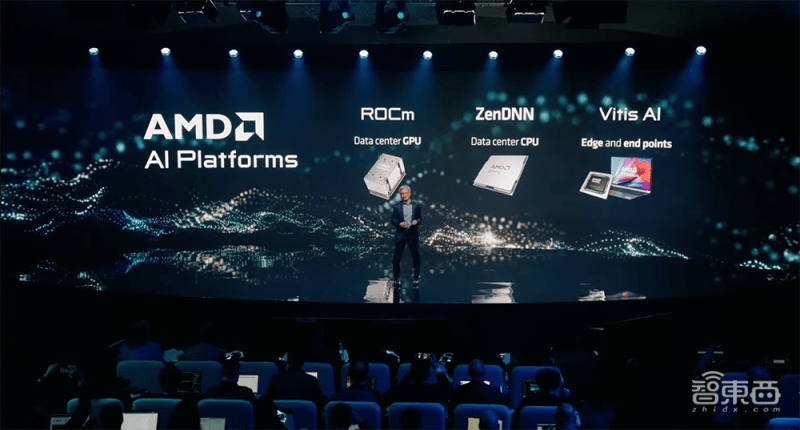

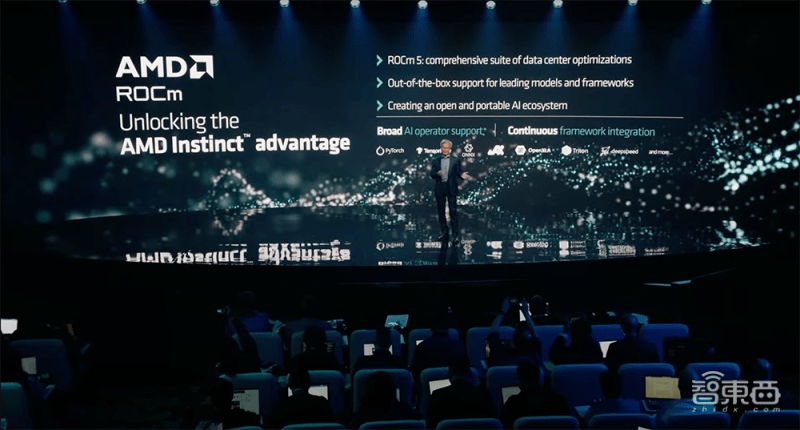

此外,英偉達近年備受開發者偏愛的一大關鍵護城河是CUDA軟體。AMD 總裁Victor Peng也展示了AMD在開發軟體生態方面所做的努力。

AMD計劃在AI軟體生態系統開發中採用「開放(Open)、成熟(Proven)、就緒(Ready)」的理念。

AMD的ROCm是一套完整的庫和工具,用於優化AI軟體棧。不同於CUDA,這是一個開放的平台。

AMD還分享了PyTorch與ROCm的合作。新的PyTorch 2.0的速度幾乎是之前版本的兩倍。AMD是PyTorch基金會的創始成員之一。

AMD正在不斷優化ROCm。Victor Peng說:「雖然這是一段旅程,但我們在構建可與模型、庫、框架和工具的開放生態系統協同工作的強大軟體棧方面取得了真正的巨大進步。」

二、雲原生處理器Bergamo:128核,256個線程,最高vCPU密度

再來看下AMD的數據中心CPU。

蘇姿豐首先分享了AMD EPYC處理器的進展,特別是在全球範圍內可用的雲計算實例方面。

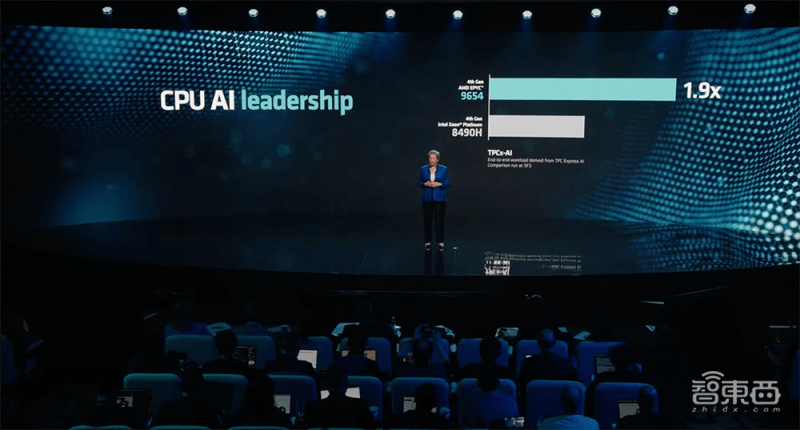

她強調說,AMD第四代EPYC Genoa處理器在雲計算工作負載方面的性能是英特爾競品的1.8倍,在企業工作負載方面的性能提高到1.9倍。

絕大多數AI都在CPU上運行,AMD稱,與英特爾至強8490H相比,第四代EPYC在性能上遙遙領先,性能優勢高出1.9倍。

蘇姿豐說,雲原生處理器以吞吐量為導向,需要最高的性能、可擴展性、計算密度和能效。

新發布的Bergamo,便是雲原生處理器市場的入口。

該晶片有820億顆電晶體,提供了最高的vCPU密度。

在大散熱器下,有一個表面看起來非常像以前的EPYC的晶片,跟與Rome或Milan一樣有中央I/O晶片和8個核心復合晶片(CCD)。

Bergamo的每個插槽有多達128個核心、256個線程,分布在8個CCD上,每個CCD的核心數量是Genoa 16個核心的兩倍,採用比標準Zen 4內核提供更高密度的全新Zen 4c核心設計,並支持一致的x86 ISA。

「Zen 4c針對性能和功耗的最佳平衡點進行了優化,這為我們提供了更好的密度和能效,」蘇姿豐在演講中談道,「結果設計面積縮小了35%,每瓦性能顯著提高。」

Bergamo現在正在向AMD的雲客戶發貨。AMD還分享了第四代EPYC 9754與英特爾至強8490H的性能、密度和能效和對比:

除了Bergamo的新核心和Chiplet架構之外,該處理器與Genoa有很多共同之處,包括支持12通道DDR5內存、最新PCIe 5.0、單插槽或雙插槽配置等等。

不過,多核心不再只是AMD處理器獨有的特色。不久之前,數據中心處理器新起之秀Ampere Computing剛推出擁有多達192個單線程Ampere核心的Ampere One系列處理器。英特爾也計劃在2024年初推出內核優化的至強處理器Sierra Forest,將內置144個高效能核心。

AMD還展示了其最新的緩存堆疊X晶片,代號為Genoa-X,現已上市。

該晶片針對高性能計算工作負載,包括計算流體動力學、電子設計自動化、有限元分析、地震層析成像及其他帶寬敏感型工作負載,這些工作負載受益於大量共享緩存。

Genoa-X CPU基於AMD的標準Genoa平台,採用AMD 3D V-Cache技術,通過在每個CCD上垂直堆疊SRAM模塊來提高可用的L3緩存。

該晶片可提供多達96個內核和總計1.1GB的L3高速緩存,每個CCD上堆疊了一個64MB SRAM塊。

據AMD披露的數據,在各種計算流體動力學和有限元分析工作負載方面,與英特爾最高規格的60核Sapphire Rapids至強相比,Genoa-X緩存提升的性能提高到2.2倍到2.9倍。

下圖是Genoa-X與相同數量核心的英特爾至強的性能對比:

三、即將推出全新DPU

最後,AMD簡要介紹了其網絡基礎設施。

去年AMD以19億美元收購Pensando,進入DPU賽道。AMD解釋了如何使用其DPU來減少數據中心的網絡開銷。

AMD將其P4 DPU架構稱作「世界上最智能的DPU」,並稱其Pensando SmartNIC是新數據中心架構不可或缺的一部分。

AMD還在現場展示了與Aruba Networks共同開發的智能交換機。AMD計劃將P4 DPU卸載集成到網絡交換機本身,從而提供機架級服務。

AMD最新的DPU旨在從CPU卸載網絡、安全和虛擬化任務,與當前一代P4 DPU相比將提供更高的性能和能效。

其DPU已得到微軟、IBM雲、甲骨文雲等許多主要雲提供商以及VMware虛擬機管理程序等軟體套件的支持。

AMD打算在今年晚些時候推出Giglio DPU之前擴大兼容軟體列表,推出「晶片軟體開發工具包」,以便用戶更輕鬆地在其DPU上部署工作負載。

結語:到2027年,數據中心AI加速器市場規模將超過1500億美元

全球數據中心GPU和CPU的頭部企業英偉達和英特爾均在強調其加速AI的實力。作為這兩條賽道「萬年老二」的AMD,也在競相滿足對AI計算日益增長的需求,並通過推出適應最新需求的數據中心GPU來挑戰英偉達在新興市場的主導地位。

生成式AI和大型語言模型的應用熱潮正在將數據中心推向極限。截至目前,英偉達在提供處理這些工作負載所需的技術方面具有優勢。根據市場調研機構New Street Research的數據,英偉達占據了可用於機器學習的GPU市場的95%。

「我們仍處於AI生命周期的非常、非常早的階段,」蘇姿豐預測,到2027年,數據中心AI加速器總潛在市場規模將增長5倍,從今年的300億美元左右以超過50%的復合年增長率增長到2027年的1500億美元以上。

AMD並未透露兩款MI300新晶片的價格,但這可能會給英偉達帶來一定價格壓力,之前H100價格據傳高達30000美元乃至更多。