三問智能家居語音採集。

采寫 | 南都見習記者 陳袁 南都研究員 李偉鋒

早晨起床,說一聲「打開窗簾」,就能享受明媚陽光;晚上回家,道一句「開燈,播放音樂」,溫馨燈光亮起,開始播放你喜歡的歌曲……

不過,此前曾有國外科技巨頭的智能語音助手被指「竊聽」用戶隱私,並將語音數據用於模型訓練,引發公眾憂慮。

智能家居APP採集的用戶語音信息將用於何處?是否存在泄露個人信息風險?如何保障個人權益?

南方都市報記者近日調查國內多款知名智能家居APP發現,部分APP隱私條款表述模糊,用戶語音數據去向未作明確說明,存在用於大模型訓練的可能;此外,部分平台強制用戶語音信息用於「功能優化」,不同意就不能使用語音控制。

多位受訪專家認為,智能家居APP數據處理目的需進一步明確,如果採集個人語音數據用於模型訓練需提供單獨授權選項,否則涉嫌違規。

用於「優化」?平台隱私條款指向模糊

根據《中華人民共和國個人信息保護法》,處理個人信息需遵循「告知-同意」規則,因此用戶在註冊使用智能家居APP前,都需勾選同意公司提供的隱私政策,並授權APP調用設備權限。但隱私條款往往冗長複雜,少有用戶會注意到,除去採集相關語音數據外,部分公司還將用戶語音數據用於模型訓練也寫入了隱私條款。

不過,部分APP對於具體「優化 」什麼,語焉不詳。

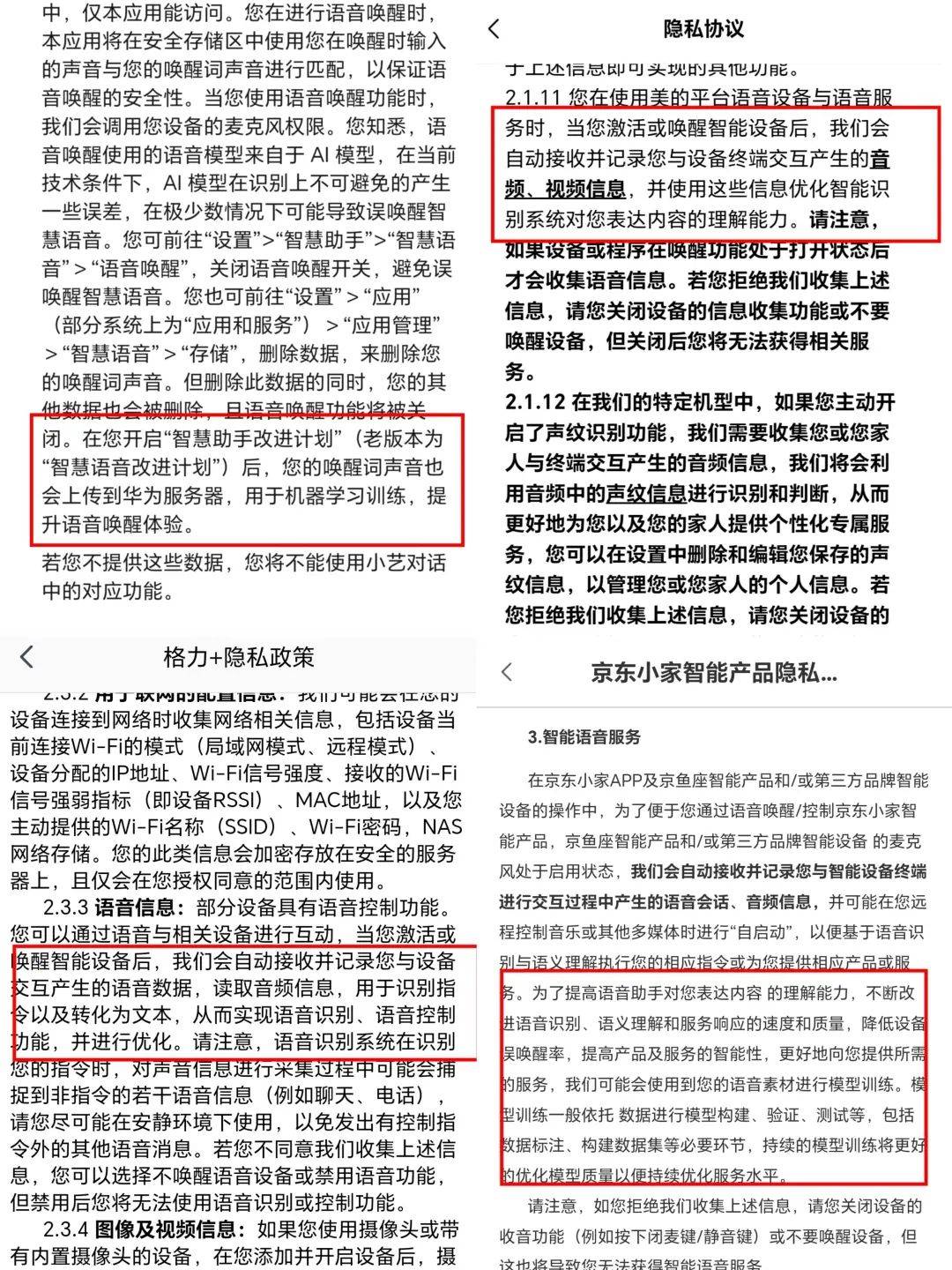

部分智能家居APP隱私政策「優化」相關表述截圖。

但海爾、美的和格力的隱私條款,對「優化」的描述就比較模糊。

隱私條款中類似「優化」的模糊表述較為普遍,這會使個人用戶處於較為被動的地位。

「因為對於後台的數據使用情況,用戶缺乏感知,很大程度上依賴的是企業的披露和定期的技術審計結合外部監督」,上海資深數據合規律師劉律師認為,從監管趨勢來看,《網絡數據安全管理條例》對數據處理者提出了更具體的要求,網絡數據處理者按照前款規定向個人告知收集和向其他網絡數據處理者提供個人信息的目的、方式、種類以及網絡數據接收方信息的,應當以清單等形式予以列明。

用於訓練大模型?專家:應獲得用戶單獨授權

對於不少智能家居APP在隱私政策中的採集個人信息數據用於「優化」功能表述,上海資深數據合規律師劉律師認為,可能涉及兩種數據採集情況,一種是為正常使用產品功能採集所需的用戶語音記錄,如為糾正功能錯誤進行的疊代升級等;另一種是模型或者產品進一步優化所需要的數據採集,比如讓模型更「聰明」。

劉律師指出,前者屬於功能實現所必需,後者是優化服務需要,對於用戶數據的採集和使用需區分開二者。

根據《App違法違規收集使用個人信息行為認定方法》,僅以改善服務質量、提升用戶體驗、定向推送信息、研發新產品等為由,強制要求用戶同意收集個人信息,可被認定為「違反必要原則,收集與其提供的服務無關的個人信息」。

例如在京東小家的隱私政策中,把疊代產品功能和優化模型兩個目的綁定在一起,要求用戶在使用產品的時候就同時授權了模型優化目的所進行的數據收集,或存在合規問題。

6款智能家居APP語音數據有關隱私政策測評結果。

根據《App違法違規收集使用個人信息自評估指南》,當App運營者收集的個人信息超出必要信息範圍時,應向用戶明示所收集個人信息目的並經用戶自主選擇同意。

對此,美的和海爾相關部門均回復記者,用戶可以通過隱私郵箱要求單獨關閉「優化」功能,並承諾關閉後會將用戶數據從後台刪除,不用於後續的「優化」用途。

隱私安全風險在哪?專家:聲紋特徵有唯一性

使用用戶語音數據訓練、優化模型是否必要?風險在哪裡?

一般來說,模型訓練是為了完善產品服務和質量,真實用戶數據能夠提供豐富的上下文和多樣性,從而提高模型的預測能力和準確性。模型訓練涉及到用戶個人數據的採集、傳輸、儲存和分析,一般會採用數據加密和去標識化處理等方式保障個人信息安全,但隱私泄露的風險仍然存在。

在中國電子技術標準化研究院網安中心測評實驗室副主任何延哲看來,真實用戶語音數據訓練有助技術進步,但採集使用每個用戶家庭數據並非完全必要。模型訓練涉及用戶日常談話內容、說話習慣,涉及到聲紋特徵等敏感個人信息,需確保用戶明確同意並尊重其選擇權。

何延哲解釋,在個人數據分析和處理過程中,一般採取去標識處理,將個人標識去除得較為徹底,便可以達到匿名化效果。但語音信息中包含的聲紋特徵等本身就具有唯一性,如果徹底匿名化,唯一性消失,又會影響到模型訓練所需數據信息的真實性。

科技進步需求與隱私泄露風險同時存在,何延哲坦言,「如何在其中尋求平衡,在個人信息保護措施更加充分的情況之下,去推動個人信息發揮更大價值,讓個人信息價值在陽光下發揮作用,需要社會各界擺平心態,以發展的視角來權衡利弊,達成共識」。

END