聯發科執行長蔡力行表示,AI引領科技發展,生成式AI更使AI無所不在。聯發科先進運算將從邊緣設備端到雲計算,推動無所不在混和式AI運算。

蔡力行COMPUTEX Taipei 2024主題演講表示,為應對AI無所不在需求,聯發科四大支柱從邊緣至雲計算各類高性能運算單元、AI加速器各類領先技術、實現邊緣至雲計算混合式AI的先進無線網絡技術,以及堅強的全球生態系及供應鏈長期夥伴合作關係。

蔡力行解釋四大支柱。從邊緣至雲計算的各類高性能運算單元,聯發科過去五年不斷突破,移動晶片CPU性能提升2.6倍、GPU性能提升6倍、NPU性能更大幅提升18倍,且系統功耗在重度遊戲和AI攝影減少60%。顯示聯發科技術創新和能源效率的領先實力。

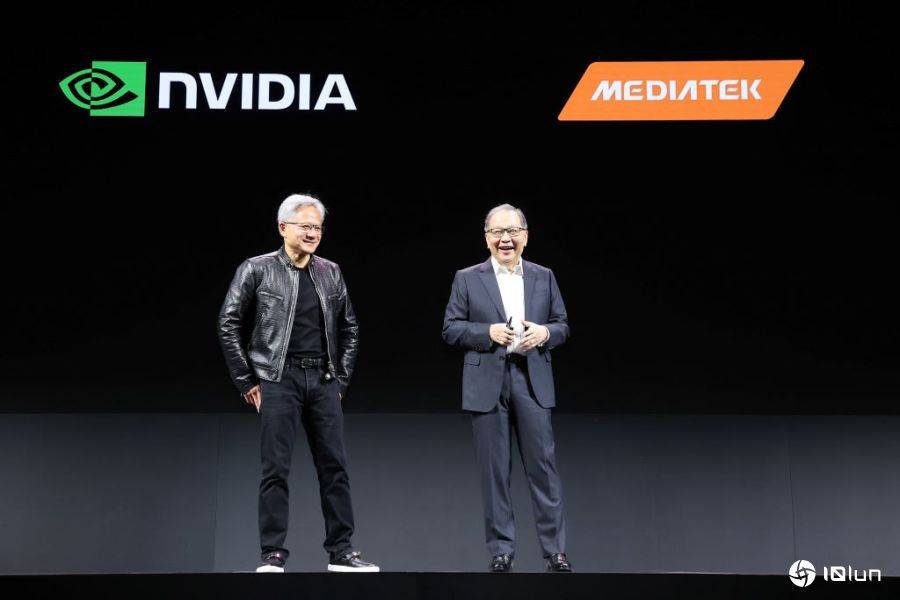

最新旗艦手機晶片天機9300+ 的NPU AI算力達68TOPS,比AI PC NPU要求40TOPS還高。聯發科將高性能運算延伸至汽車智能座艙晶片,並與英偉達合作,結合聯發科高性能運算及英偉達AI和繪圖運算領先優勢,提升CPU及AI性能,大語言模型延遲更低和體驗更佳。

此外,聯發科將把邊緣運算優勢延伸至雲計算,Arm執行長Rene Hass親臨提到AI影響力相當廣泛,聯發科與ARM合作是抓住市場機會的關鍵。聯發科宣布通過Arm Neoverse運算符系統 (CSS), 加速雲計算晶片設計與開發。

AI加速器各類領先技術,應對快速增加AI訓練與推論需求,雲計算服務商除了積極部署數據中心,也尋求更定製化解決方案以優化特定領域性能,並降低總擁有成本,聯發科預估定製化AI雲計算市場規模自2023年約76億美元,增長至2028年450億美元,多數為AI加速器。

聯發科有許多雲計算AI定製化晶片解決方案IP,占利基性市場,幫助雲計算廠商降低總擁有成本,如Interconnect SerDes、UCIe、D2D及Optical等高速傳輸介面IP。3及2納米先進位程、2.5D/3D Chiplet先進封裝,以及HBM等都有堅強開發及集成能力。

蔡力行強調,雲計算最關鍵的SerDes,聯發科開發,2022年推出112G技術後,今年有市場最先進224G IP,未來持續開發400G及CPO。聯發科致力提供可持續、可擴展,且具能源效率的解決方案,提供客戶優異AI加速器解決方案。

實現混合式AI先進無線網絡,蔡力行指出,未來AI運算在邊緣端及雲計算都需部署,且為了有效發揮混合式AI優勢,邊緣端與雲計算需創建高速可靠連接,聯發科具備所有關鍵有線及無線技術,5G部分,聯發科由手機延伸至FWA、PC、汽車及物聯網設備等,還有5G RedCap、5G NTN衛星寬頻、 Wi-Fi及乙太網絡等無線及有線技術。

混合式AI架構下,AI無所不在,可語音互動並能不斷學習進化的AI個人助理,及直接執行大語言模型的車載語音助理,多螢幕互動並偵測駕駛警覺性。這些都是AI可能的深刻變革,改善用戶生活效率及品質。聯發科生成式AI應用還有照片物體移除、背景生成,以及即時生成式AI動畫與圖片產生等。

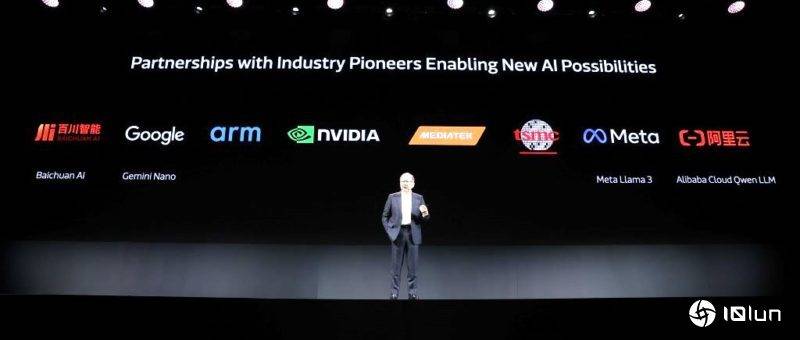

最後,聯發科有堅強全球生態系及供應鏈長期夥伴合作關係,積極與全球AI產業領導者合作如Arm、台積電、英偉達、Google、Meta、百川智能及阿里雲大語言模型,共同推動無所不在AI。英偉達執行長黃仁勛也親自到場,強調與聯發科合作對開發汽車市場的重要性,兩家公司大型語言模型訓練、邊緣AI設備等領域會有更多合作機會。

(首圖來源:聯發科)