目標挑戰NVIDIA、專門開發AI運算系統的創業公司Cerebras宣布發布「Cerebras Inference」AI推論工具平台,努力打破NVIDIA在AI晶片市場壟斷局面。

外媒《金融時報》(Financial Times)報道,包括Cerebras、d-Matrix和Groq等小型公司的目標是在AI晶片市場中獲得市場占有率,並將重點放在更便宜、專運行AI模型的晶片上。

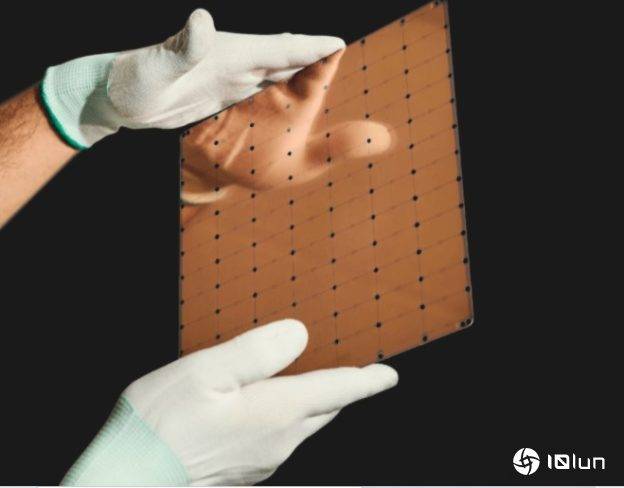

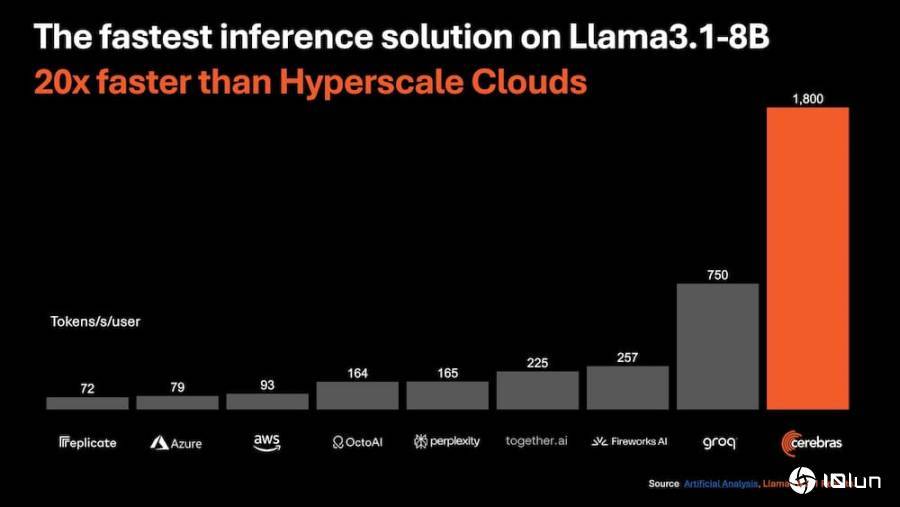

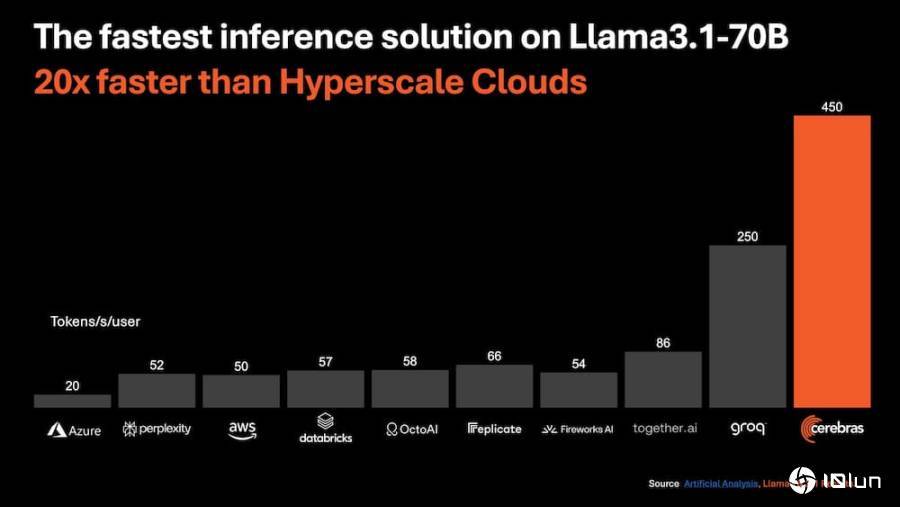

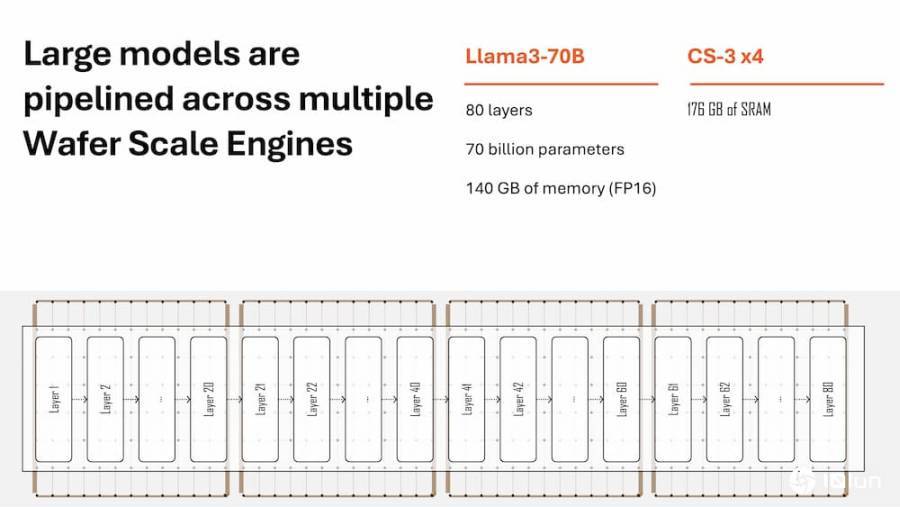

Cerebras全新的「Cerebras Inference」平台以CS-3晶片為基礎,晶片只有餐盤大小。該公司宣稱,這個解決方案在Llama 3.1 8B模型上每秒可生成1,800個Token,在Llama 3.1 70B模型上每秒可生成450個Token,在AI推理速度比NVIDIA Hopper晶片快20倍,但成本僅五分之一。

Cerebras執行長Andrew Feldman指出,「擊敗800磅大猩猩(意指NVIDIA)的方法,是將更好的產品推向市場,我們已從(NVIDIA)那搶走不少有意義的客戶」。

CS-3晶片沒採用NVIDIA所使用的獨立高帶寬內存(HBM)晶片,而是提供另一種直接將內存內置於晶片中的架構。Feldman指出,其優勢在於內存使用方式,因為內存帶寬的限制,會限制AI晶片推論速度,因此將邏輯晶片和內存結合至單一大晶片中,可提供「幾個量級的速度」。

也因此,Cerebras的晶片不像GPU和其他處理器,需要介面連接內存才能訪問資訊。彭博社報道,Cerebras這個方法依賴由單片矽晶片製成的巨型晶片。通過這種新技術,Cerebras的晶片功能比傳統同類產品強,但傳統硬體無法容納這些超大尺寸晶片,必須設計專容納這些晶片的計算機。

Feldman形容,「直到今天,我們還處於Gen AI撥接時代,沒多少GPU可拼湊在一起,實現這個目標」,而他的計算機將顛覆AI產業,使AI系統反應更迅速,如同轉換到高速網絡。

據悉,Cerebras已提交一份首度在公開募股中出售股票的保密計劃,同時創建自家數據中心,試圖將晶片銷售給微軟、亞馬遜等雲計算服務供應商。

d-Matrix、Groq同樣對NVIDIA虎視眈眈

另一家創業公司d-Matrix也有同樣的野心。

d-Matrix計劃今年底全面推出自有晶片平台Corsair。d-Matrix創辦人Sid Sheth指出,該公司將產品與Triton等開放式軟體搭配,目前NVIDIA最大客戶支持使用Triton等開放軟體。應用程式開發人員不喜歡被某種特定工具所束縛,人們也逐漸發現受NVIDIA的AI軟體平台Cuda限制。

d-Matrix由創辦人Sid Sheth於2019年創立,在新加坡國有基金淡馬錫領投的B輪融資中籌得1.1億美元,不到一年便啟動新一輪融資。d-Matrix目標是在今年或明年初籌集2億美元以上資金。

另一家AI推理競爭對手Groq本月從BlackRock Private Equity Partners領投的投資者那籌集6.4億美元,估值為28億美元。知情人士透露,晶片製造商Graphcore上個月被軟銀以略高於6億美元收購,少於2016年成立以來籌資約7億美元的風險資金。

(首圖來源:Cerebras)